V tekmi za razvoj splošne umetne inteligence, v kateri vodita OpenAI in Google DeepMind, sta razumevanje in repliciranje človeku podobne inteligence postala pomemben raziskovalni interes. Osrednji del tega tehnološkega napredka je model Transformer, katerega temeljna načela se zdaj poglobljeno raziskujejo.

Kako razumeti umetno inteligenco?

Ključ do zmogljivih sistemov umetne inteligence je razumeti, kako se uči in si zapomni informacije. Ekipa raziskovalcev iz Centra za kognicijo in socialnost ter Skupine za podatkovno znanost v okviru Inštituta za osnovno znanost (IBS) se je lotila razumevanja učenja človeških možganov, pri čemer se je osredotočila zlasti na utrjevanje spomina prek receptorja NMDA v hipokampusu. To znanje pa bi lahko uporabila kot model za razumevanje umetne inteligence.

Preberi: Kako lahko ChatGPT izkoristiš pri študiju in kje je popolnoma nesmiseln?

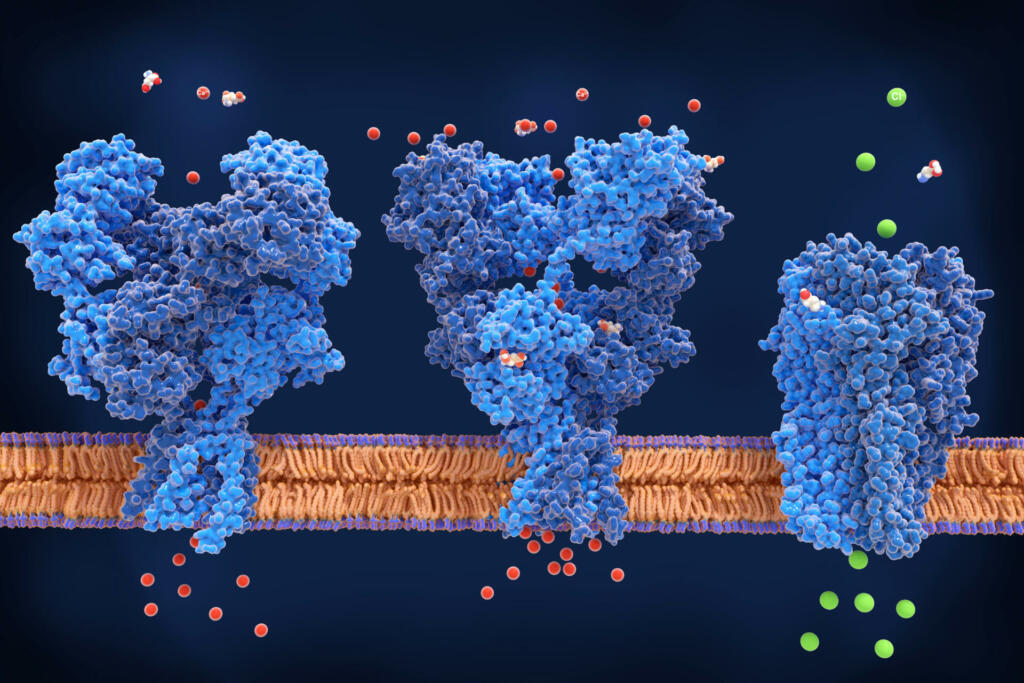

Kaj so receptorji NMDA in kako delujejo?

Receptor NMDA si lahko predstavljamo kot nekakšna pametna vrata v možganih, ki olajšajo učenje in oblikovanje spomina. Ob prisotnosti molekule, imenovane glutamat, pride do vzburjenja živčne celice. Po drugi strani pa magnezijev ion deluje kot majhen vratar, ki blokira vrata. Šele ko se ta ionski vratar umakne, se snovi lahko pretakajo v celico. To je proces, ki možganom omogoča ustvarjanje in ohranjanje spominov, vloga vratarja (magnezijevega iona) v celotnem procesu pa je precej specifična.

Novi raziskovalni interesi

Ekipa je prišla do zanimivega odkritja: zdi se, da model Transformer uporablja proces varovanja vrat, podoben možganskemu receptorju NMDA. To odkritje je raziskovalce spodbudilo k raziskovanju, ali lahko konsolidacijo spomina v modelu Transformer nadzoruje mehanizem, ki je podoben procesu zapornic receptorja NMDA.

Znano je, da v živalskih možganih nizka raven magnezija oslabi spominsko funkcijo. Raziskovalci so ugotovili, da je mogoče dolgoročni spomin pri Transformerju izboljšati s posnemanjem receptorja NMDA. Tako kot v možganih, kjer spreminjanje ravni magnezija vpliva na moč spomina, je prilagajanje parametrov Transformerja, ki odražajo delovanje zapornice receptorja NMDA, privedlo do izboljšanja spomina v modelu umetne inteligence. Ta prelomna ugotovitev kaže, da je mogoče način učenja modelov umetne inteligence pojasniti z uveljavljenim znanjem nevroznanosti.

Justin LEE, ki je direktor nevroznanosti na inštitutu, je dejal: »Ta raziskava je ključni korak k napredku umetne inteligence in nevroznanosti. Omogoča nam, da se poglobimo v načela delovanja možganov in na podlagi teh spoznanj razvijemo naprednejše sisteme umetne inteligence.«

CHA Meeyoung, ki je podatkovni znanstvenik v ekipi in na KAIST, ugotavlja: »Človeški možgani so izjemni, saj delujejo z minimalno energijo, za razliko od velikih modelov umetne inteligence, ki potrebujejo ogromno virov. Naše delo odpira nove možnosti za poceni in visoko zmogljive sisteme umetne inteligence, ki se učijo in si zapomnijo informacije kot ljudje.«

Prihodnost umetne inteligence

To študijo odlikuje pobuda za vključitev možgansko navdihnjene nelinearnosti v konstrukt umetne inteligence, kar pomeni pomemben napredek pri simuliranju utrjevanja spomina, na način podoben človeškemu. Konvergenca človeških kognitivnih mehanizmov in zasnove umetne inteligence ne obeta le ustvarjanja poceni in visoko zmogljivih sistemov umetne inteligence, temveč omogoča tudi dragocen vpogled v delovanje možganov s pomočjo modelov umetne inteligence.

Novinar